仁寶於輝達GTC公布高密度AI伺服器方案 囊括6大核心技術亮點

記者許若茵/台北報導

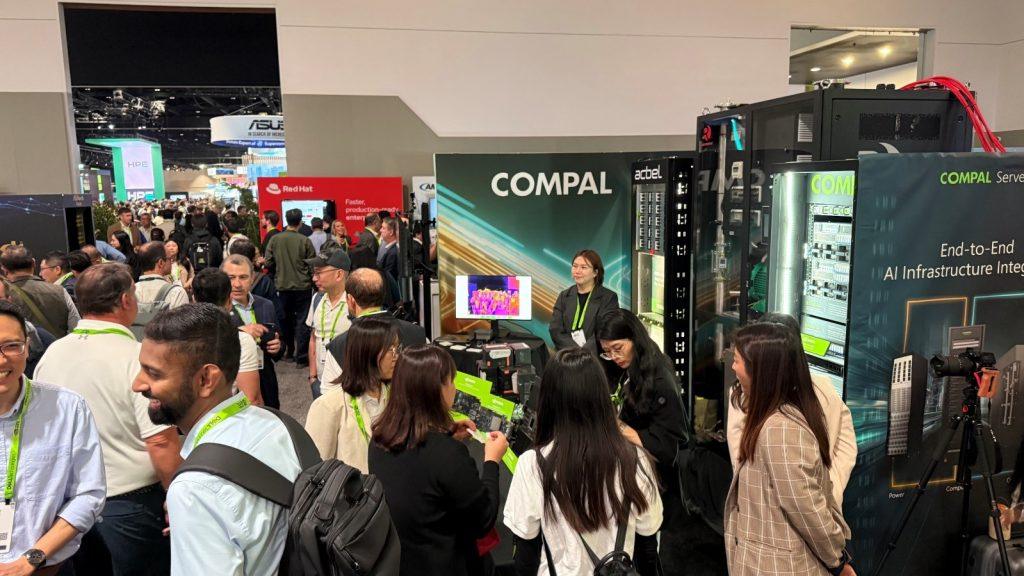

隨著生成式AI與Agentic AI應用快速擴展,AI訓練與推論工作負載正推動資料中心架構邁向更高運算密度與更高頻寬互連。仁寶電腦於NVIDIA輝達 GTC 2026展會中,展示其基於NVIDIA HGX™ Rubin NVL8平台打造的高密度AI伺服器解決方案,並與NVIDIA提出的「六款全新晶片、一部出色的AI超級電腦」NVIDIA Vera Rubin架構願景相呼應,展現仁寶在新世代AI超級運算基礎設施上的工程整備能力。

NVIDIA Vera Rubin架構整合了NVIDIA Vera CPU、NVIDIA Rubin GPU、NVIDIA NVLink™ 6 Switch、NVIDIA BlueField®-4 DPU、NVIDIA Spectrum-X™ Ethernet與NVIDIA ConnectX®-9 SuperNIC,形成完整的異質運算架構。透過 NVLink™ 6 交換技術,NVL72 機櫃級配置可提供最高 260 TB/s的總互連頻寬,並實現每顆GPU 3.6 TB/s的全互連頻寬(all-to-all bandwidth),可有效支援Mixture-of-Experts(MoE)模型與大規模 AI 訓練與推論工作負載。

此次仁寶推出的 SG231-2-L1 系統即基於NVIDIA HGX™ Rubin NVL8平台設計,其核心技術亮點包括:

- 高密度加速架構(High-Density Accelerated Architecture)

於 2U 機箱中整合 8 顆 NVIDIA Rubin GPUs,在有限機櫃空間內最大化運算密度與部署效率。 - 高效 AI 推論與訓練能力(Advanced AI Performance)

系統最高可提供 400 petaFLOPS(NVFP4)運算性能,可支援大型語言模型(LLM)訓練與推論、生成式 AI 與 HPC 應用場景。 - 高頻寬 GPU 互連(High-Bandwidth GPU Interconnect)

採用 NVIDIA NVLink™ 6 技術,提供最高 28.8 TB/s GPU-to-GPU 互連頻寬,大幅提升多 GPU 協同運算與擴展效率。 - 可擴展記憶體架構(Scalable Memory Architecture)

支援最高 2.3TB GPU 記憶體容量與 176TB/s 記憶體頻寬,可滿足記憶體密集型 AI 應用需求。 - 高功率密度液冷設計(High Power Density Liquid Cooling)

透過優化的 直接液冷(Direct Liquid Cooling, DLC)設計,系統可穩定支援約 24kW 功耗運作,確保高負載 AI 工作負載下的穩定效能。 - 機櫃級部署整備(Rack-Level Deployment Readiness)

系統設計可無縫整合至 高密度 AI 機櫃架構,支援從單節點到資料中心規模的彈性部署與擴展。

在展位現場,仁寶也展示基於NVIDIA HGX™系統架構的NVIDIA Vera CPU HPM模組,展現其在 NVIDIA Vera CPU與 NVIDIA Rubin GPU平台上的工程整備與製造能力。隨著運算架構持續演進,CPU與GPU的協同設計正逐步成為資料中心架構優化的重要關鍵。

此外,仁寶亦展示對NVIDIA RTX PRO™ 4500 Blackwell Server Edition的支援。該GPU配備32GB GDDR7記憶體與最高800 GB/s記憶體頻寬,可為AI推論、資料處理與視覺運算工作負載提供高效能加速能力。

仁寶電腦基礎架構事業群副總經理張耀文表示,「AI基礎設施的競爭焦點,已從單一節點效能的比較,轉向整體部署效率與長期可擴展性的能力。隨著NVIDIA HGX™ Rubin NVL8平台在運算效能與功率密度上的持續提升,資料中心架構也必須同步演進。我們不僅強化運算能力,也持續提升整體基礎設施在承載能力與擴展性上的設計,使客戶能建立面向下一世代AI工作負載的可持續部署架構。」

隨著AI工作負載持續規模化,資料中心競爭力正逐漸由 生態系協同與整體架構整合能力所決定。透過此次GTC 2026展示,仁寶展現其在高密度GPU系統設計與液冷散熱技術上的工程實力,並進一步深化其在NVIDIA技術生態系中的長期策略合作。

![]()