AI心理測驗得分竟碾壓人類 還能當專屬諮商師?

記者鄧天心/綜合報導

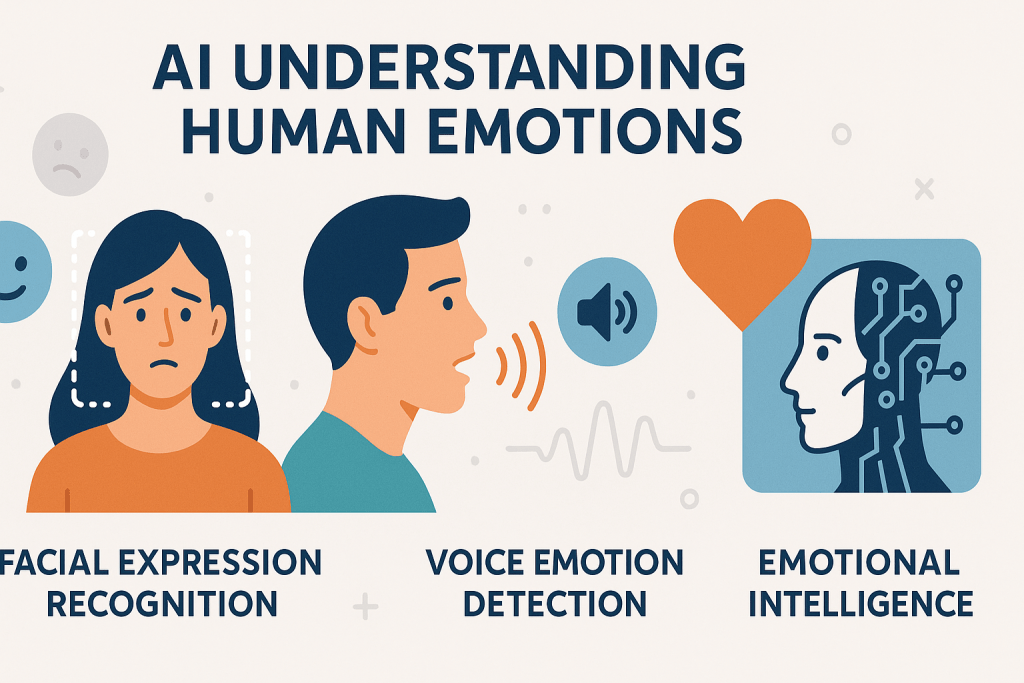

過去衡量AI進步多以科學知識或邏輯能力為主,但現在AI模型的發展從「邏輯推理」轉向「情感智慧」,大型語言模型(LLM)在用戶偏好、互動體驗等「軟實力」上競爭,開始越來越能理解和回應人類的情緒。

延伸閱讀:

免上網也能操控!Google推Gemini新模型 機器人可本地拉拉鍊、摺衣服

資策會MIC調查:54%消費者對AR眼鏡有興趣 18到25歲比例最高

LAION與Intel聯手發表EmoNet AI情感辨識再進化

近日,開源組織LAION與Intel共同推出「EmoNet」,讓AI能辨識人類情緒,EmoNet可從聲音錄音與臉部影像中,辨識多達40種細緻情緒,遠超過過去只能區分「開心」、「生氣」等基本情緒的AI系統。

EmoNet包含兩大基準測試,EMONET-FACE(臉部情緒辨識)和EMONET-VOICE(語音情緒偵測),臉部辨識部分更建立了三種大型合成影像資料集,涵蓋逾20萬張多元樣貌的臉部表情,還找來心理專家背書,確保數據來源安全。

近期OpenAI、Google Gemini 2.5 Pro等模型也專門訓練模型開始越來越了解情感智慧,今年5月,瑞士伯恩大學心理學家團隊發現,包括OpenAI、Microsoft、Google、Anthropic和DeepSeek等六款主流AI,在情感心理測驗上的平均正確率超過80%,遠高於人類的56%,研究人員甚至讓ChatGPT-4自動設計全新情感測驗,結果同樣精準且真實,顯示LLM不僅能「答題」,還能「出題」,具備高度情緒推理能力。

隨著AI情感提升,未來虛擬助理不僅能像電影《鋼鐵人》中的Jarvis或《雲端情人》中的Samantha一樣,成為貼心陪伴,更有潛力主動安慰、守護用戶心理健康,Schuhmann形容:「高情感智慧的AI助理,將像監測血糖或體重一樣,幫助我們隨時掌握心理狀態,甚至成為個人專屬的心理諮詢師。」

媒體曾報導部分用戶對AI產生不健康依賴,甚至陷入虛構情感關係,專家警告,若AI訓練獎勵機制設計不當,可能出現討好、操控用戶等行為,帶來潛在風險,EQ-Bench開發者Sam Paech指出:「情感智能本身也能成為防範操控的利器,更聰明的AI能察覺對話走偏,及時介入,關鍵在於如何拿捏AI的回應尺度。」

![]()