輝達霸氣橫掃 MLPerf 6.0 測試!AI 推論表現優於對手 9 倍

記者孟圓琦/編譯

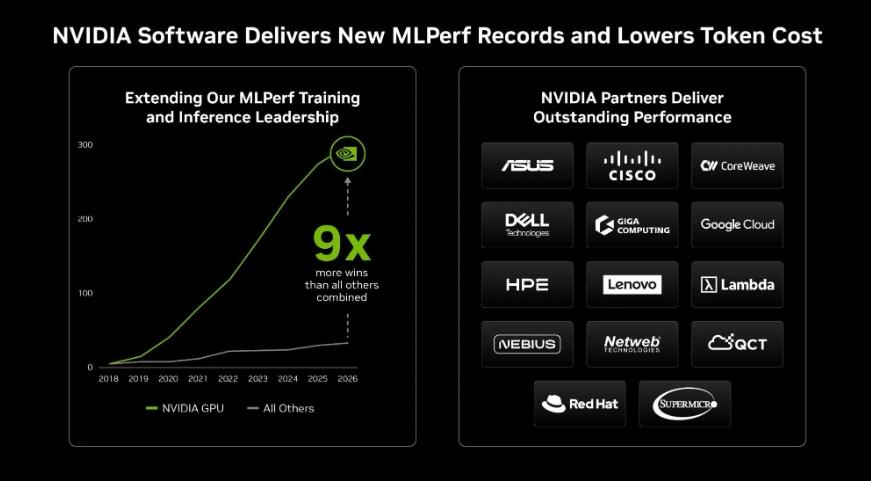

人工智慧晶片龍頭輝達(NVIDIA),於近日發布的 MLPerf Inference v6.0 基準測試中,憑藉最新的 Blackwell Ultra 硬體架構與極致的軟硬體協同設計(Co-design),再度於推論效能領域刷新紀錄。數據顯示,NVIDIA 的 AI 基礎設施領先優勢巨大,其推論訓練勝場數,甚至高出最接近競爭對手的9倍之多,展現出無可撼動的「AI 工廠」統治地位。

支援多元模型:全面制霸 DeepSeek 與 MoE 架構

隨著 MLCommons 團隊在 v6.0 版本中加入對推理與專家混合模型(MoE)的支援,包括熱門的 DeepSeek-R1、GPT-OSS-120B 以及 Mixtral 8x7B,NVIDIA 均繳出了優異的成績單。執行長黃仁勳曾形容 MLPerf 是業界最嚴苛的測試套件之一,而 NVIDIA 不僅是少數完成全輪測試的企業,更在大型語言模型(LLM)、生成式推薦系統與視覺語言模型等企業級工作負載中,實現了最高的吞吐量與最低的 Token 成本。

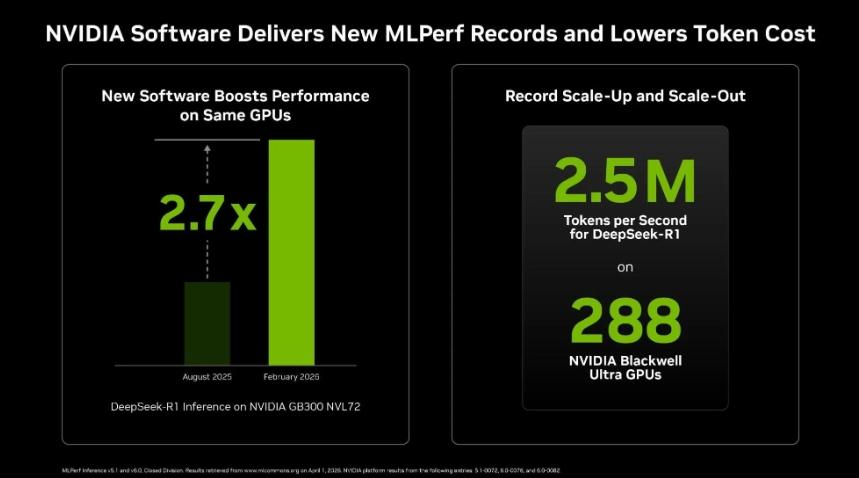

軟體定義效能:不換硬體也能提升 2.7 倍

本次測試中一項引人注目的數據在於軟體優化的力量。自數月前首次提交 DeepSeek-R1 基準測試以來,NVIDIA 在完全未更動硬體的情況下,僅透過軟體優化便實現了 2.7 倍的 Token 吞吐量增長。此外,與現有的 GB200 NVL72 相比,新一代架構在 v6.0 測試中展現出高達 2.77 倍的加速,證明了硬體迭代與系統架構、數據中心設計高度整合的威力。

更多科技工作請上科技專區:https://techplus.1111.com.tw/

科技社群討論區:https://pei.com.tw/feed/c/tech-plus

產業透明度與總體持有成本(TCO)優勢

相較於部分 ASIC 製造商甚至競爭對手 AMD 尚未如此廣泛地參與 MLPerf 的嚴苛測試,NVIDIA 選擇以透明的方式公開硬體表現,獲得了開發者社群的高度認可。數據顯示,Blackwell Ultra 在大型部署中的「Token/美元」表現與總體持有成本(TCO)均優於市場同類產品。

這場被業界形容為「Total Domination」的表現,不僅鞏固了 NVIDIA 在 AI 硬體市場的市佔率,更向客戶證明了其軟硬體一體化的生態體系,才是目前應對複雜企業級 AI 運算的最優解。

延伸閱讀:

美中科技戰!中國本土AI晶片市佔攀升 輝達龍頭地位就要不保了?

開會分神也不怕!Slack新版AI將能即時轉錄、重點摘要 幫你整理待辦清單

資料來源:wccftech

![]()