AI招聘系統的問題|專家論點【張瑞雄】

作者:張瑞雄 台北商業大學前校長/叡揚資訊顧問

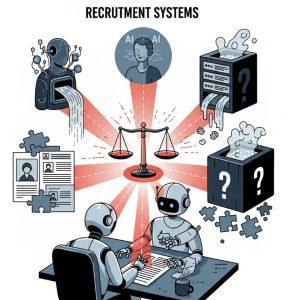

人工智慧(AI)正迅速滲透各行各業,其中在人力資源領域的應用尤為引人關注。企業逐漸仰賴AI來協助招聘和裁員決策,表面上此舉能提高效率、降低成本,但實際上卻引發了不少爭議和風險。

根據近期調查指出,美國已有超過六成的管理者在工作中使用AI,而令人不安的是,六成中的九成的管理者坦承在決定員工的升遷、加薪甚至解僱時會運用AI工具,這相當於超過一半的管理階層會透過AI來做出攸關員工生計的重大決定,其中一些管理者完全依靠AI的判斷,未經人為審核即做出人事決定。危險的是只有三分之一的管理者曾接受正式的AI使用訓練,顯然很多是在未知AI風險之下就依賴AI來做決策。

這種趨勢帶來的問題顯而易見,AI系統儘管被視為中立、公正,但其實仍受限於訓練資料及演算法設計者的偏見。若AI訓練數據集不夠多元,便會產生演算法偏見(Algorithmic Bias),導致系統對特定性別、族群、或具有特定特徵的候選人做出不公平甚至歧視性的評估。例如亞馬遜曾經使用AI進行招聘,卻因訓練數據以男性居多,造成系統自動降低女性候選人的評分,最終被迫終止該系統。

延伸閱讀:

AI醫療輔助應用的困難|專家論點【張瑞雄】

AI搜尋的信任危機|專家論點【張瑞雄】

此外AI招聘系統的不透明性也引發法律及道德上的疑慮,當招聘或裁員決策過於仰賴AI,企業可能面臨潛在的歧視訴訟及相關法規懲處。特別是歐盟的《一般資料保護規範》(GDPR)及美國紐約市2023年7月起生效的AI招聘偏見審計規定,都要求企業必須定期進行外部審核,以避免AI決策產生歧視。

更值得深思的是,當AI用於招聘時,也可能成為有心人士利用的漏洞。美國司法部便破獲一起來自北韓的網路犯罪案件,該案涉及北韓透過假冒遠端IT工作人員的方式,成功滲透百餘家美國科技企業,甚至竊取敏感技術資料與虛擬貨幣資產。這些北韓駭客利用AI生成假身份和簡歷,順利通過企業的招聘審核,進而獲得系統存取權限,造成重大資安風險與財務損失。

面對這些挑戰,企業必須重新審視AI在招聘中的角色。首先企業應採取更嚴格且全面的AI系統審核措施,確保AI系統的數據來源多元、無偏,並且定期進行內外部審計,降低潛在的偏見風險。其次企業應提供管理者足夠的AI使用訓練,強調AI應輔助人類決策而非取代人類決策,避免AI系統做出違反倫理或法律規範的判斷。

此外必須加強AI系統的透明度與可解釋性,讓AI決策過程對員工更加透明,建立更具信任感的職場環境。企業也應主動建立內部倫理治理框架,並接受外部監督,以確保招聘過程的公正性與透明性。

AI固然能提升人力資源管理的效率,卻也伴隨著巨大的倫理、法律與安全風險。企業若未能及早因應這些挑戰,不僅可能影響企業形象與信譽,甚至可能導致嚴重的法律後果。因此善用AI之餘,更要謹慎面對其背後潛藏的風險,透過積極的管理和監督措施,才能真正實現人與AI共存的理想職場願景。

![]()