影子AI正在企業蔓延釀資安風險 但問題其實不在員工?|專家論點【朱楚文】

作者:朱楚文(IC之音竹科廣播《科技領航家》主持人)

那天和一位在科技公司工作的朋友吃飯,他突然問我一個問題:「你現在工作會用AI嗎?」我說當然會,寫稿、整理資料、找靈感,有時候真的很方便。他笑著說:「我們公司最近一直鼓勵大家多用AI提升效率,但IT部門同時又開始提醒大家,不要把公司資料貼到AI裡。」我問他:「那大家還敢用嗎?」他說:「其實大家都在用,只是很多不是公司給的工具。」有人用AI整理會議紀錄,有人用AI幫忙寫程式,也有人把報告丟進AI請它幫忙潤稿,效率確實變快了;但問題是,大多數工具都不是公司正式批准的。

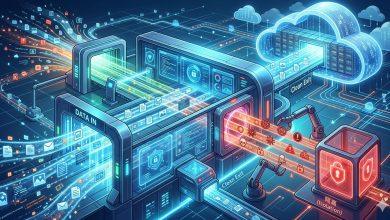

這種情況,正是資安界最近熱門討論議題:「影子AI」(Shadow AI)。影子AI,簡單來說,就是員工在沒有公司批准的情況下,自己找AI工具來完成工作,因為在暗處,公司無法掌握,如同影子般成為公司使用AI的黑洞。影子AI會造成什麼問題呢?除了公司資料可能外洩,我在節目訪談資安專家還提到,員工以為運用外部AI能更快速解決公司難題、強化開發產品速度,但當把程式碼、會議紀錄、客戶資料,甚至是內部策略文件輸入到AI系統時,這些資料就可能流向外部平台,其實等於幫競爭對手養AI,不知不覺削弱公司競爭力。然而,影子AI雖然無法上檯面,也有不少公司明令禁止,但還是比想像中普遍,甚至主管違規使用比例還比一般員工高!

生產力軟體公司Nitro Software在去年調查發現,有高達68%的高階主管違規使用AI工具,比例遠高於一般員工的50%。究其原因,簡單來說就是AI真的太好用了。當你發現一個工具可以把兩小時的工作縮短成二十分鐘,很少人會真的忍住不用。顧問公司Gartner就預測,到2030年,全球將有超過40%的組織,因為未經授權的AI工具而出現安全疑慮。其中,金融、製造、醫療等產業有更嚴格的法規,如果資料透過未授權工具流出,企業可能面臨更高的合規風險。

不過,如果只把影子AI當成「員工違規」,其實有點太簡化問題,很多員工會用外部AI工具,原因其實很單純:因為公司給的工具不好用,有些企業導入的AI系統功能很少,或是操作流程太複雜,根本無法融入日常工作。加上AI發展速度驚人,這些具有前瞻思維和學習力強的員工自發性學習新AI工具跟上時代,其實也證明了他們很優秀是個人才。

某種程度上,影子AI其實恰恰反映:問題出在企業制度和導入AI速度跟不上科技發展,導致連高層都寧願冒險尋求外部工具解決問題,形成AI數位治理亂象。所以,真正的解法,其實不是全面禁止AI,或許更該思考的是企業如何能提升AI時代的數位治理?畢竟人性都會有禁果效應,既然打不過就或許該考慮有技巧的加入它。例如國外大廠零售商沃爾瑪、LinkedIn都已為自家員工打造「生成式 AI 樂園(Generative AI Playground)」,Meta 也建立使用公司內部數據的 AI 聊天機器人「Metamate」給員工使用,就是一種解決方法。

資安專家也提到,培訓員工對於AI資安的意識,強化資料去識別化、去標籤化,讓AI能解決問題,但不會明白知道是「哪間公司」也是很重要的方向。從更大的角度來看,每當新科技出現時,通常都是個人先開始使用,企業制度再慢慢跟上,所以影子AI其實是一個過渡時期的現象,既是一種風險,其實也是一個提醒:在AI時代,真正的問題或許不是員工會不會用AI,而是企業有沒有準備好,更加速全面擁抱和管理AI?

![]()