【科技小辭典】HBM是什麼?為什麼AI一定要用這種記憶體

記者黃仁杰/綜合報導

隨著人工智慧(AI)快速發展,「HBM」成為近年半導體產業最熱門的關鍵字之一。從AI伺服器到高效能運算平台,幾乎都離不開這種高階記憶體。對多數人而言,記憶體只是電腦規格中的一項數字,但在AI時代,記憶體的角色正變得前所未有的重要。

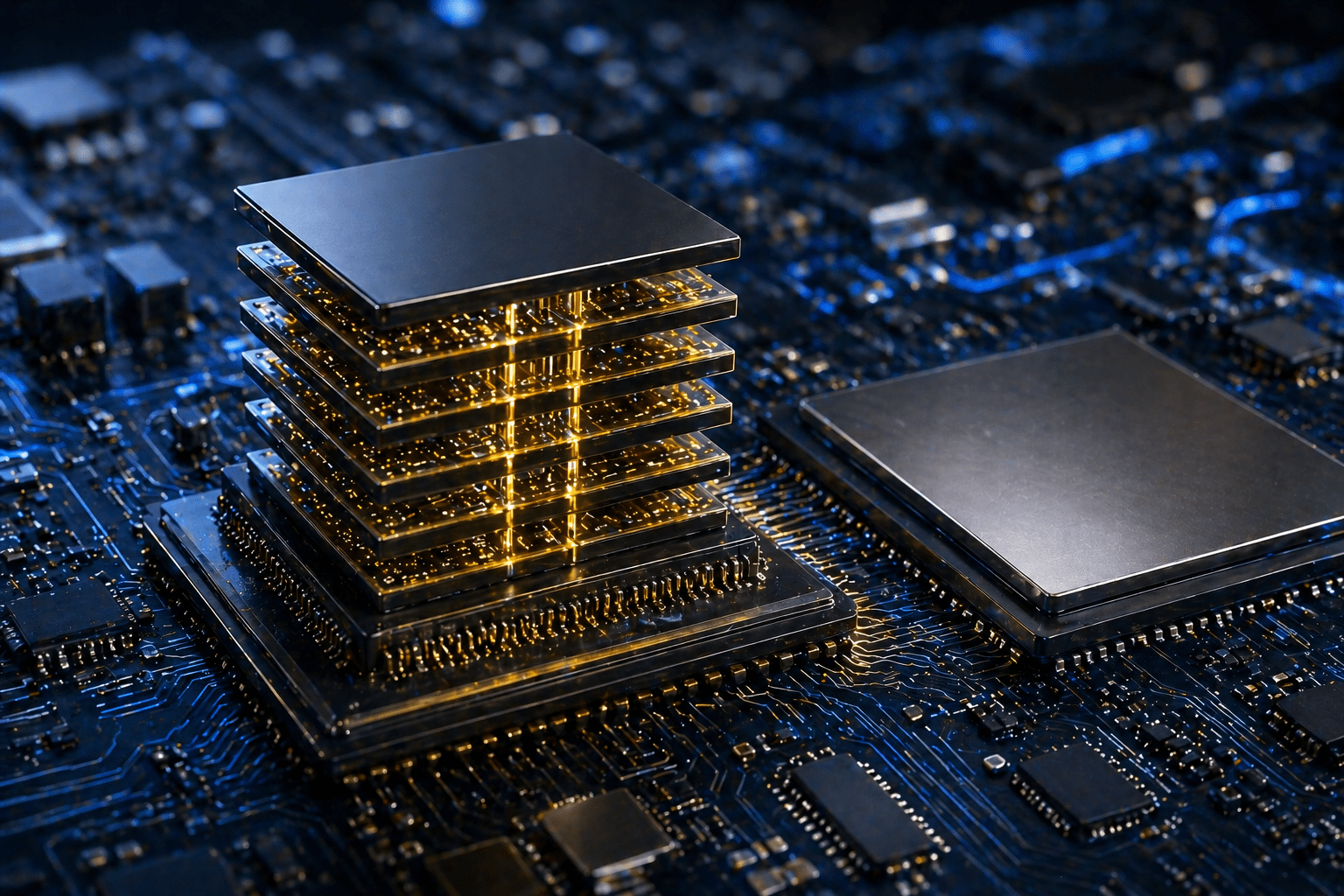

HBM,全名為高頻寬記憶體(High Bandwidth Memory),與一般筆電或手機使用的記憶體最大不同,在於「傳輸速度」。傳統記憶體主要透過較窄的通道傳輸資料,而HBM則是將多層記憶體晶片垂直堆疊,並透過寬頻通道同時傳輸大量資料,大幅提升頻寬與效率。

這樣的設計,正好對應AI運算的需求。當前AI模型需要處理龐大的資料量,不只是計算能力強就夠,還必須能快速讀取與傳送資料。若把AI晶片比喻為大腦,記憶體就是負責供應資訊的管道,一旦速度跟不上,再強的晶片也無法發揮效能。

更多科技工作請上科技專區:https://techplus.1111.com.tw/

科技社群討論區:https://pei.com.tw/feed/c/tech-plus

目前AI晶片龍頭NVIDIA所推出的產品,幾乎全面搭配HBM記憶體;而記憶體供應則由SK海力士、三星電子與美光科技等大廠主導,形成新一輪產業競爭焦點。

不過,HBM並非沒有代價。由於採用3D堆疊與先進封裝技術,製造難度與成本遠高於傳統記憶體,也導致供應相對吃緊。這也是為何近年記憶體價格上升,進一步影響AI伺服器甚至筆電成本的原因之一。

隨著AI應用持續擴大,HBM需求仍將快速成長,甚至可能成為限制AI發展速度的關鍵資源。未來不只是晶片性能競爭,誰能掌握記憶體供應,也將影響整體產業版圖。

![]()