Google開源Vault Gemma!首款防洩密AI語言模型免費下載

記者鄧天心/綜合報導

Google研究團隊與DeepMind近來共同發表Vault Gemma,這是一款從零開始、完整採用差分隱私(Differential Privacy, DP)技術訓練的大型語言模型,不僅在規模上達到10億參數,更將所有權重與技術細節公開於Hugging Face與Kaggle平台,方便開發者與研究單位自由取用、測試與改進。

Vault Gemma最大的突破,就在於訓練過程全程導入差分隱私防護機制,嚴格管控資料暴露風險,這種作法能有效降低模型「記住」個別敏感資訊的可能性,讓AI在發揮強大運算能力的同時,也兼顧用戶隱私。

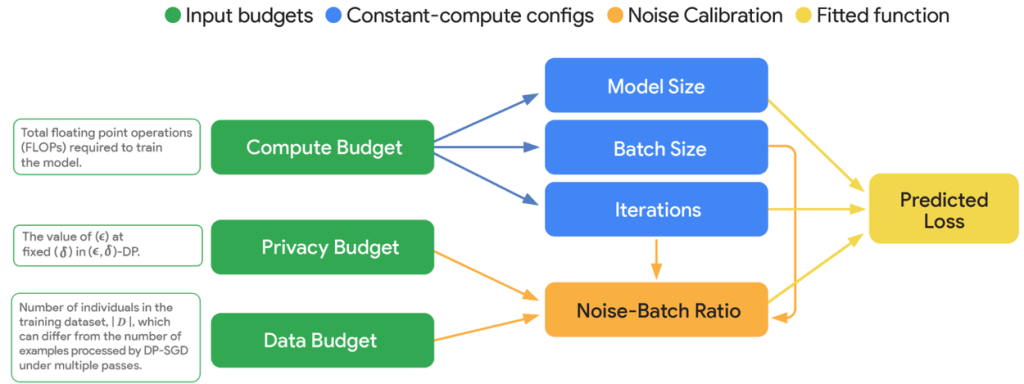

根據官方測試結果,Vault Gemma的差分隱私防護強度達到(ε ≤ 2.0, δ ≤ 1.1e-10)水準,這代表即便模型被反覆查詢,也幾乎不會外洩特定訓練樣本的內容,此外,團隊首度建立差分隱私模型的縮放定律,讓模型大小、批次規模與噪聲比例等關鍵變數間的動態能精準預測,提供產業界規劃高效、低風險AI部署的重要依據。

延伸閱讀:

超越Photoshop!Google靠Nano Banana衝上App Store冠軍

在效能表現方面,Vault Gemma在ARC-C、PIQA、TriviaQA等主流語言理解測試中的表現已逐漸逼近無隱私強化機制、相同規模的語言模型,甚至接近五年前非DP模型(如GPT-2 1.5B)的水準。雖然與最新完全無隱私保護的模型相比仍有落差,但VaultGemma在個資安全、開源彈性及合規應用上的價值,已為AI落地帶來嶄新可能性。Google也同步釋出技術報告與完整訓練指南,協助企業與研究機構依據自身運算資源與隱私預算,彈性調整模型配置與訓練策略。

就產業應用而言,Vault Gemma的問世對於高度重視個資合規的領域,例如金融、醫療、政府等,具有重要意義。該模型幾乎不存在資料記憶化風險,能協助組織落實資料治理、通過法規審查,同時維持AI應用的生成與推理能力。企業在導入這類模型時,可進一步檢視內部資料處理流程、加強隱私衝擊評估,並參考國際隱私標準,讓AI應用兼顧效率與合規。

Google強調,Vault Gemma的推出只是「隱私AI」發展的起點,未來還會持續精進差分隱私訓練技術,進一步縮減效能差距、降低運算門檻,讓資料安全與智能應用能在企業端真正並行不悖。隨著全球隱私法規日益嚴格,具備差分隱私特性的AI模型,有望成為產業升級轉型、強化國際競爭力的關鍵利器。

資料來源:research.google、mashdigi.com

![]()