輝達推出新一代AI模型「Eagle 2.5」 性能直逼參數大十倍的GPT-4o

記者鄧天心/綜合報導

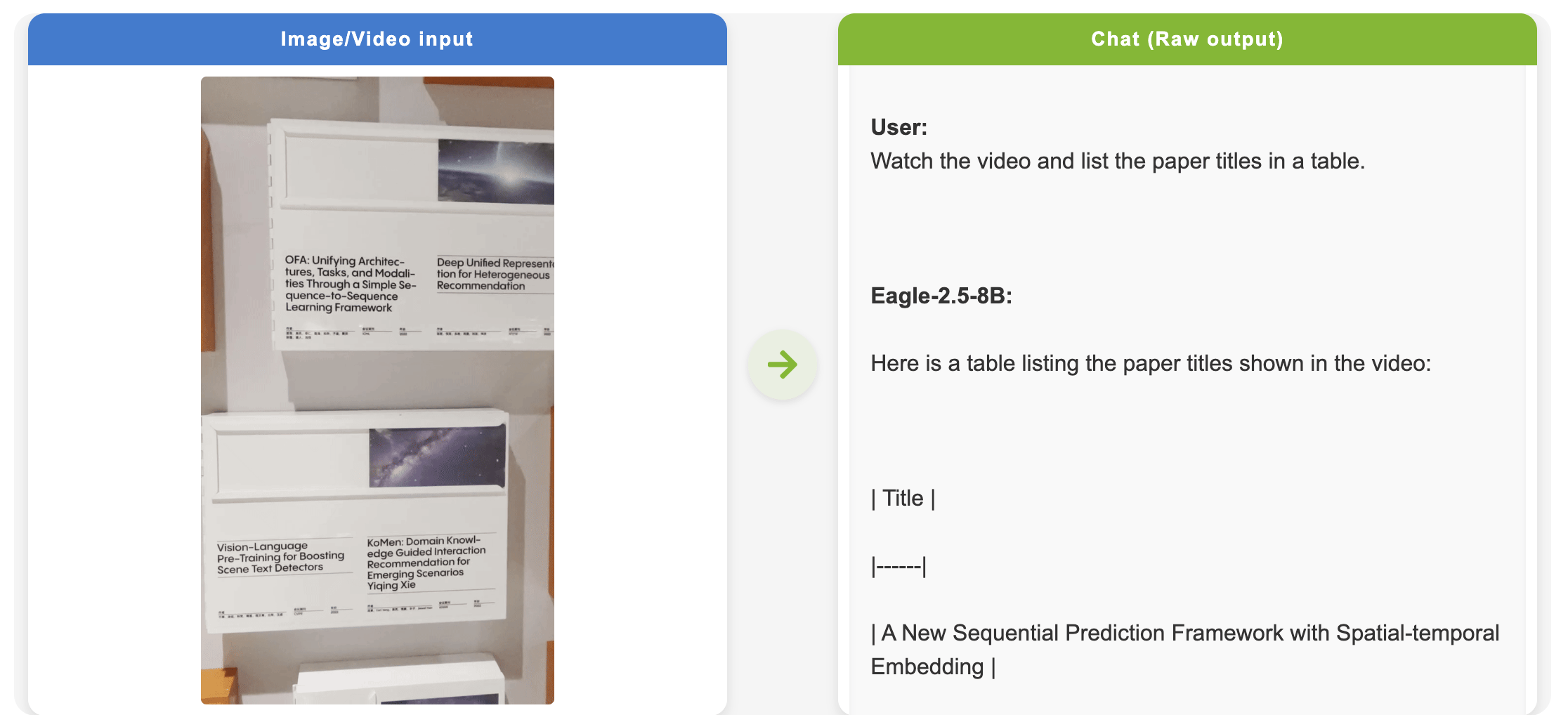

輝達(NVIDIA)於美國時間4月21日推出新一代視覺語言模型模型「Eagle 2.5」,只用了8億個參數,卻能和參數量高達80億的GPT-4o等AI模型在長篇影片、圖像理解等多模態任務上一較高下,顛覆過去「模型越大越厲害」的印象,針對長影片、高解析度的圖片,Eagle 2.5能更準確理解畫面的資訊,在Video-MME的測試中,一次看完512張連續畫面,判讀準確率高達72.4%,和比它大好幾倍的開源模型相比也毫不遜色。

更多新聞:聯電法說駁格羅方德合併傳言!與Intel合作設廠最新進度曝光

新一代AI模型Eagle 2.5的三大亮點

Eagle 2.5主要歸功於三大創新技術,第一是「資訊優先採樣」,Eagle 2.5會透過「圖像區域保留」(IAP)技術,保留大部分原始圖像的區域和縱橫比,減少圖片失真的情況,並根據情境自動調整圖像和文字的比例。第二是「漸進式訓練法」從簡單的短內容開始,逐步增加內容的長度和複雜度,讓AI模型在訓練過程中逐步適應不同情境的資料,第三是「多元資料訓練」,結合開源資料和自家收集的Eagle-Video-110K數據集,讓AI能理解各種場景和故事。

NVIDIA AI研究部門主管在接受專訪時表示:「Eagle 2.5代表了AI可以用更少的參數達到甚至超越大型模型的性能,這不僅降低了計算資源需求,也為AI普及立下新的里程碑。」

Eagle 2.5的成功,也讓過去研究AI模型以「參數規模至上」為原則開始轉向,往更注重效率和精確的方向發展,目前Eagle 2.5已在開源平台上上線,有望在醫療影像分析、自動駕駛視覺辨識等領域帶來突破,現在大家可以在GitHub找到相關資源,隨著更多開發者加入,我們可以期待更多Eagle 2.5的應用將會出現。

![]()