AI對隱私的漠視很危險|專家論點【張瑞雄】

作者:張瑞雄 台北商業大學前校長/叡揚資訊顧問

數十萬筆與AI聊天機器人的對話,竟在毫無警示之下被搜尋引擎收錄,無論是求職者的聯絡資料與履歷、使用者與AI的心理諮詢,甚至包括如何製作致命藥物或武器的指示內容,都在無意間被攤在陽光下。某些平台甚至在開發者明知風險存在的情況下,仍選擇默默推行「分享功能」,讓數以十萬計的對話被索引進搜尋結果中,任人點閱,毫無遮掩。

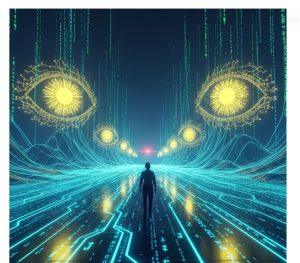

這顯見在這場數位變革的狂飆中,社會卻似乎忽略了一個根本問題,人類是否還擁有對自身資料的主控權?當人們與AI互動時,他們所分享的資料是否還能受到妥善的保護?

更令人錯愕的是,有的對話內容甚至包含了虛擬暗殺計畫與自我傷害的技術細節,不僅挑戰了道德底線,更直接違反平台自己宣稱的使用條款。這不再只是單一企業的錯誤判斷,而是整個AI開發與應用生態的制度性盲點。當資料洩漏不再是駭客攻擊的結果,而是設計疏失或默許的副產品,那麼我們面對的,就不只是技術的問題,而是價值的崩解。

有人可能會辯稱,這些是「使用者自己按下分享鍵」的結果,應該自負其責。但事實遠比這簡化式說法更複雜,絕大多數使用者並不清楚「分享」意味著什麼,更不可能預料對話會變成可供搜尋的網頁被永久留存。當平台在設計介面時刻意省略風險提示,或者用模糊語言掩蓋功能邏輯,這已構成一種資訊操弄與責任轉嫁。

科技公司也許會聲稱這些漏洞已經修補,或引用「白帽駭客」的貢獻來淡化事件嚴重性。但每一次外洩都像是剝開一層幻象的保護膜,讓人看見背後對安全機制的輕忽、對道德標準的彈性詮釋,以及對使用者信任的粗暴消費,難掩企業對風險的輕率與漠視。

更值得警惕的是,這些外洩資訊正成為新的數位操控工具。有行銷業者已開始有計劃地利用AI平台的索引機制,在對話中植入品牌關鍵字,藉此操控搜尋引擎結果。這種行為不僅違反了公眾對AI中立性的期待,也預示著未來資訊環境將更加難以信賴。當虛擬對話可以被操縱為資訊搜尋工具,事實與虛構、誠信與欺瞞的界線將更加模糊。

AI的開發者與應用者經常以創新為名,要求監管單位「暫緩干預」,訴諸「不能扼殺科技進步」的論調。但如果科技的進展建立在使用者毫無知情的資料貢獻之上,那便不是進步,而是掠奪。在這樣的生態中,資料的產權與道德的邊界不再清晰,取而代之的是企業對風險的模糊承諾與對責任的推託閃避。

這些問題不只牽涉個人隱私,更對整體經濟生態造成深遠影響。當使用者對AI平台的信任崩潰,其實際代價遠超過一則新聞報導的熱度。企業若無法保障資料安全與透明運用,終將導致市場信心流失、合作關係斷裂,甚至引發監管反撲與消費者集體訴訟。從長遠看,這會影響AI技術的投資意願、商業發展與整體產業的可持續性,形成隱形的經濟摩擦與創新阻礙。

在這場人機關係快速重構的時代,我們急需一場誠實的關於資料擁有權、關於設計責任、關於使用者的知情同意,還有關於什麼才是值得追求的科技進步。這不僅是對某幾家公司的要求,而是對整個社會的提問。我們要的,是能尊重人性、守護信任的科技,而不是一味逐利、操控資訊的虛假繁榮。

如果我們繼續對這類問題掉以輕心,等待的將不是AI世界的黃金年代,而是一場又一場由無形資料引爆的信任危機。唯有建立起兼顧創新與責任的治理機制,才能真正讓科技成為文明的延伸,而不是毀壞社會契約的利器。

![]()