人工智慧能否消除招聘中的偏見問題?

編譯/莊閔棻

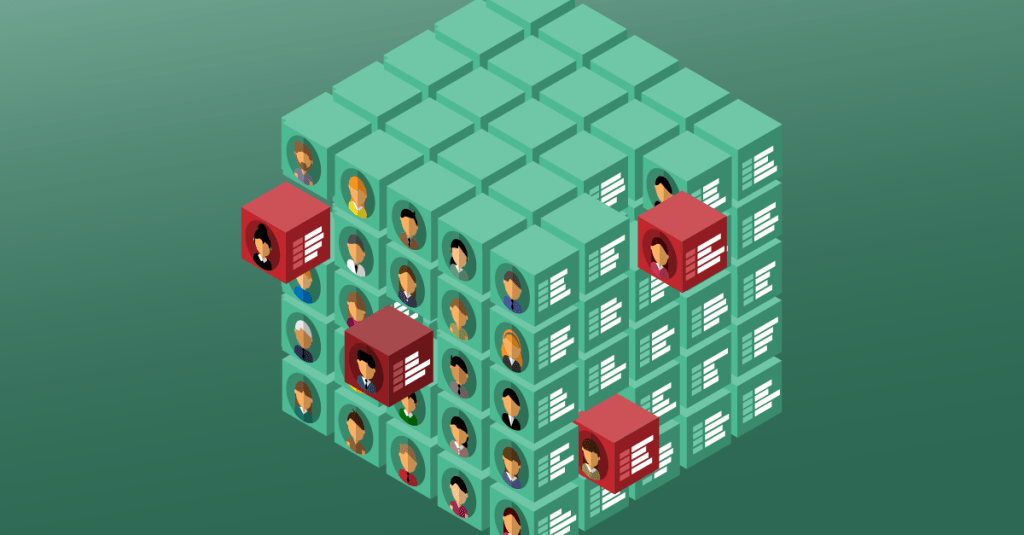

隨著人工智慧在招聘中越來越普遍,出現了對偏見和公平性的擔憂。一些專家認為,透過消除人類的主觀性,人工智慧實際上可以減少招聘過程中的偏見。然而,其他專家則對此憂心忡忡,因為人工智慧演算法缺乏透明度,必須進行仔細的監測和監督,以確保公平性。

根據《衛報》的報導,人工智慧因為可以為企業和政府機構,把成本高、耗時長的流程自動化而受到歡迎。有很多澳洲的人工智慧公司就聲稱,其技術將減少招聘過程中的偏見。然而澳洲的功績制保護委員辦公室(The office of the Merit Protection Commissioner)就警告說,人工智慧可能會根據優勢以外的東西來評估候選人,引起對透明度和數據偏見的道德和法律問題,產生有偏見的結果,或錯誤的解釋一些人格特質,並造成「統計偏見」。

解決人工智慧招聘中的偏見的一個潛在辦法,是使用不同的數據集來訓練。透過納入各種來源的數據,人工智慧就可以更好地了解不同人的細微差別,減少偏見的風險。然而,功績制保護委員辨公室的警告是有道理的。畢竟,AI在偏見方面的記錄一直令人擔憂。

2017年,亞馬遜就悄悄的取消了一個實驗性的招聘排名工具,該工具的訓練過程因為帶有偏好男性的偏見,因此系統性的降低了女性簡歷的等級;2020年,一項美國研究表明,微軟和IBM等公司創造的臉部分析技術在淺色皮膚的受試者和男性身上表現得更好,深色皮膚的女性則最經常被程式忽略;去年(2022年),劍橋大學的一項研究也表明,人工智慧不是一個好的招聘人員。因為,該機器是透過詞語和人們身體之間的關聯來找出「理想的候選人」,而不只是觀察或識別這些特質。

以「人工智慧招聘系統的監管和歧視問題」作為博士論文研究題目的博士生Natalie Sheard說,缺乏透明度的篩選方式是一個巨大的問題。她舉例說:「訊息驅動的應用程式是基於自然語言處理的,類似於ChatGPT,所以這些系統的訓練數據往往是講標準英語的人的話語或想法。因此,如果你不使用標準的英語文法,它就可能會說你沒有良好的溝通技巧,或者你可能有不同的文化特徵,而系統會因為是針對母語者進行培訓而無法識別。」

但即使有這些擔憂,人工智慧招聘仍可能可以為雇主和求職者提供巨大的好處。透過自動化招聘過程的某些方面,如簡歷篩選和安排面試,人工智慧可以節省時間並提高效率。此外,人工智慧可以幫助候選人與適合其技能和經驗的工作相匹配,從而為雇主和求職者帶來更好的結果。

但Sheard也認為我們需要更多監管。她說:「社會上對人工智慧系統的理解程度很低,而且由於雇主非常依賴這些東西,他們(目前)在沒有任何治理系統的情況下使用(該工具)。」雖然雇主沒有惡意,但可能會因此造成一些問題。

參考資料:The Guardian

![]()