Meta推出LLaMA避免在全球AI競爭中處於劣勢|專家論點【Howie Su】

作者:Howie Su(產業分析師)

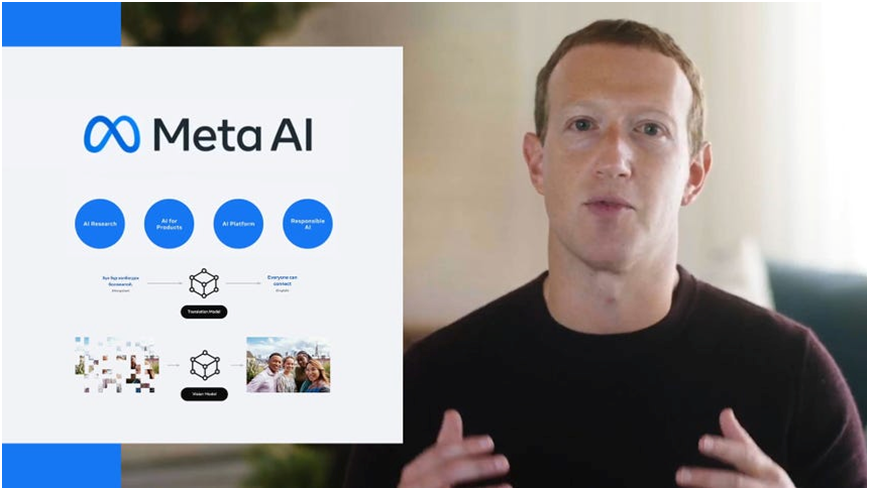

Meta將營運重心轉回人工智慧競爭

在ChatGPT推出不久後,Meta也推出自家的AI語言生成模型「LLaMA」作為回應。不過,與ChatGPT不同的是,LLaMA並非能與之交談的軟體,它是一種研究工具,Meta希望透過它來達到AI普及化,其主要功用為協助AI專家修正與調整有問題的模型,避免出現偏誤、歧視等問題。公司指出 LLaMA 模型的第LLaMA-13B版本在大多數測試中較GPT-3 模型表現更佳,經過訓練後,LLaMA-13B 還可以在Nvidia Tesla V100 GPU 上運行。相較之下,LLaMA比較類似瑕疵檢測系統,而非像ChatGPT走商業化產品路線,但這也與Meta近期策略相關:從元宇宙的願景逐漸轉回現實,過去Meta錯過AI聊天機器人的開發,當前公司正在盡力趕上,以降低廣告業務收入下跌帶來的衝擊;同時,Meta正在調整資源配置,包括降低資料中心投資、審慎投資新創,與裁員。

或許腳步晚了些,但Meta看到的市場依舊龐大,除了大型語言模型帶來的發展潛力外,機器學習在廣告、詐欺偵測、電腦視覺、安全監控、預測分析、自然語言處理、AR/VR的應用熱度不減,在應用場域龐大下,Meta或許只需要持續投入,就可慢慢迎頭趕上。

白宮《人工智慧權利法案藍圖》帶來的挑戰

當然,機器學習的猛爆式成長也引來不少擔憂,根據MLOps供應商comet發布的「機器學習產業概況」(State of MLOps Industry Report)報告指出,美國白宮科技政策辦公室 (WHOSTP) 最近發布《人工智慧權利法案藍圖》,法案涵蓋五項原則:安全與有效系統、演算法偏見保護、資料隱私、可解釋性、備用計畫等,本質上而言是透過對於人類的保護來限制演算法的應用範疇,這對於Meta而言道也不一定是壞事,既然LLaMA本身就是為了協助人工智慧能夠更透明、更符合普世價值,反而可以藉機成為競爭優勢。

如果再仔細看,可發現《人工智慧權利法案藍圖》對機器學習的影響在未來會開始增強,舉例而言,「安全與有效系統」要求企業開發演算法時應徵求不同社群、利害關係人與專家意見,而非僅透過企業內部決定,此舉用意為降低演算法帶來的風險和潛在影響,而演算法在使用前應進行測試、風險識別,並在部署後持續間空,以證明其安全性,並遵守各種標準,這樣的要求立意良好,但可能讓許多資源較少的企業卻步,增加如Meta、Google等大型企業的勝算。另外,模型的使用者都應該要有「知」的權力,或稱為可解釋性,系統的設計者、開發者和部署端應提供文字說明,涵蓋對系統功能的描述,常見的可解釋AI技術涵蓋精度,召回率、準確性、ROC曲線、確定係數(R平方)等,使得機器學習模型有一定程度的可解釋性,降低使用者的不安心理,同時符合法規需求,這些都是法案對機器學習模型的要求,也是使得科技業未來避免讓人工智慧野蠻生長的主因。

Meta的下一步:讓模型隱身幕後來優化服務

整體來說,當前局勢對攻堅又面臨不少挑戰,祖克柏前陣子還被抱怨公司營運下滑下個人安保費用卻持續上升,相較之下,其對手微軟與Open AI的合作、或是Google也推出新的LLM模型迎戰顯得Meta遇到相當困境,LLaMA模型或許目前看起來不是決勝負的武器,但Meta 計劃將這些新技術融入幾乎所有產品,例如圖像生成、影音、虛擬分身等,有別於其他同業將模型作為產品服務,Meta選擇將機器學習設立為各種服務的最佳優化推手,這場戰爭還有得打。

![]()

-390x220.jpg)